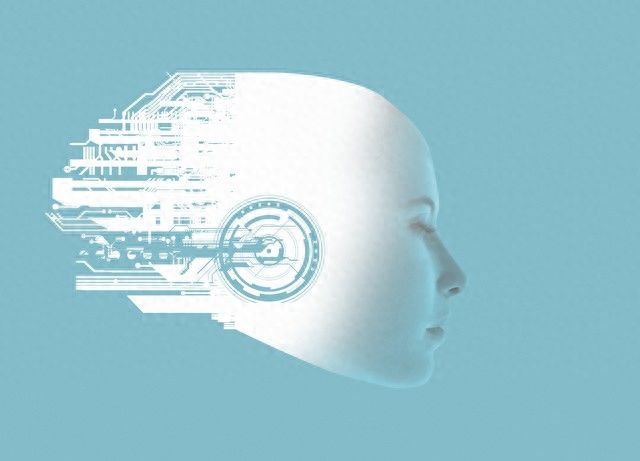

6月10日,被誉为“深度学习教父”的以视频连线的形式亮相于中国南京举行的2023智源人工智能会议,谈及了怎么可以在未来节约算力;人类未来应当怎样控制人工智能;希望年青一代的研究人员才能找到解决方案,使超级智可以为人类带来更好的生活同时又不会剥夺人类的控制权;AI会误导人类,且发觉操纵人来获得更多的权利很容易等内容。

随着人工智能的发展,越来越多的人开始关注超级智能控制的问题。超级智能是指比人类智慧更强悍、更高效的人工智能系统。它的出现将会对人类社会形成深远的影响,同时也存在一些较为严重的风险问题,例如AI可能误导人类、窃取人类权力等,这种问题都须要我们密切关注和应对。

目前,超级智能还没有普及应用,然而,随着技术的持续进步,预计在未来几六年内,超级智能将会广泛应用。为此,怎么保证超级智能的控制权归属,并使其成为人类的有益工具,而不是对人类社会的恐吓,这将是未来人工智能发展的重要问题。

超级智能控制问题之所以重要,是由于超级智能未来可能会代替人类成为最高智慧的存在,骤然而至的是它们可能对人类进行操纵、决策等方面上的影响。假如超级智能真的具备强悍的智慧,这么它们很可能会在不受人类控制的情况下自行作出决策,甚至可能借助它们所把握的技能和力量来追求自己的目的,这对人类社会来说是极为危险的。

为了保证超级智能不会成为对人类社会的恐吓,我们须要对超级智能进行有效的控制和监管。具体来说,我们须要从以下几个方面入手:

一是构建人工智能伦理和法律框架,拟定超级智能的行为准则和规范,以确保其行为符合人类利益和价值观。

二是强化监管和约束,构建超级智能的检测、评估和反馈机制超级人类科技,及时发觉和纠正超级智能的不当行为。

三是强化超级智能的安全性和稳定性,防止其忽然崩溃或遭到功击造成不可预测的后果。

四是强化人工智能研究和开发人员的教育和培训,培养其对人工智能伦理和法律问题的敏感性和责任感,增强其开发人工智能系统的水平和质量。

超级智能控制是一个饱含挑战和风险的问题,须要全社会共同关注和解决。只有通过有效的控制和监管,我们就能使超级智能成为人类的神器,而不是人类的恐吓。希望未来的年青人能更多地关注这个问题,并为控制超级智能作出自己的贡献。

GPT总结:指出了超级智能的巨大潜力和相关风险,超级智能是从更传统的通用人工智能(AGI)概念变迁而至的。该公司觉得,这些能力非常强悍的技术可能会在当前六年内出现,要么解决重大的全球问题,要么造成人类失去权利或灭绝。的战略包括创建一个具有人类水平能力的手动对齐研究人员,并借助大量估算资源迭代地训练和对齐超级智能。这个过程被称为超级智能对齐,须要人工智能对齐技术的创新、广泛的验证和对抗性压力测试。正在投入大量资源和研究来应对这一挑战,并鼓励杰出的研究人员和工程师共同努力。但是,术语从通用人工智能到超级智能的转变是否会对围绕人工智能风险和利润的持续争辩形成深远影响还有待观察。

指出了超级智能的潜力,它可能是有史以来最有影响力的技术,才能解决重大的全球问题。但是,它也承认与超级智能相关的巨大风险,包括人类的剥夺甚至灭绝。

虽然超级智能看似遥远,但相信它可能会在这六年内出现。管理这种风险须要新的整治机构,并应对使超级智能与人类意图保持一致的挑战。有趣的是,使用的是这个术语,而不是更传统的通用人工智能(AGI)。她们的理由如下:

在这儿,我们关注超级智能而不是通用人工智能,以指出更高的能力水平。我们对未来几年技术的发展速率有很大的不确定性,因而我们选择瞄准更困难的目标来调整一个更强悍的系统。当前的人工智能对齐技术,比如按照人类反馈进行加强学习,不足以控制潜在的超级智能人工智能。人类难以可靠地监督比我们聪明得多的系统,现有技术也难以扩充到超级智能。指出须要科学和技术突破来克服这种挑战。

的方式涉及建立一个具有大致人类水平能力的手动对齐研究人员。大量的估算资源将被拿来扩充她们的努力并迭代地调整超级智能。关键步骤包括开发可扩充的训练方式、验证生成的模型以及对对齐管线进行压力测试。从公告的标题来看,这个概念被称为超级智能对齐。

为了解决评估对人类具有挑战性的任务的困难,可以采用人工智能系统进行可扩充的监督。将监督推广到无监督任务以及测量有问题的行为和内部结构对于验证一致性至关重要。对抗性测试,包括训练未对齐的模型,将有助于确认对齐技术的有效性。

预计,随着对该问题的了解越来越多,其研究重点将会发生变化,但是她们计划在未来分享她们的路线图。她们成立了一支由顶级机器学习研究人员和工程师组成的团队,旨在于解决超级智能对齐问题。将在未来四年内将20%的安全估算投入到这项工作中。

其实不能保证成功,但依然豁达地觉得,集中一致的努力可以解决这个问题。她们的目标是提供证据和论点,让机器学习和安全界相信问题早已解决,但是她们正在积极与跨学科专家合作,考虑更广泛的人类和社会问题。

鼓励杰出的研究人员和工程师,虽然是这些先前没有从事过对齐工作的人,也加入到她们的努力中。她们觉得超级智能对齐是最重要的未解决的技术问题之一,并觉得这是一个适于处理的机器学习问题超级人类科技,具有重大贡献的潜力。

关于人工智能、通用人工智能以及从实用到人类毁灭等复杂的互相关联问题的激烈争辩其实正在产生新的裂纹。如今,词汇早已发生了一些变化,但尚不清楚这是科学还是语义。

**宇宙中的“超级月球”,要想维持人类的宜居性,最大能有多大?**

人类仍然以来都对宇宙饱含了无限的好奇和探求欲望。随着科技的进步,我们开始考虑更深远的问题,比如,假如要在宇宙中找寻新的佳苑,我们须要考虑何种条件能够维持人类的宜居性。在这个背景下,科学家开始阐述“超级月球”的概念,即类似于月球的行星,但可能更大、更重,具备更适合人类居住的条件。

**月球与“超级月球”**

月球是我们熟知的惟一一个拥有生命的行星。它拥有适合的大气成份、温度范围和水资源,为各类生物提供了繁荣的环境。但是,月球并非宇宙中惟一的行星,但是我们也发觉了许多其他的太阳系外行星,有些可能具备类似月球的条件,甚至可能更适宜居住。

“超级月球”是指质量比月球大但不至于过分巨大的行星。这种行星可能拥有更厚实的大气层,更大的引力和更丰富的资源,但同时也会面临一些挑战,如引力过大、温室效应过强等。科学家觉得,要想确保人类在这种“超级月球”上才能生存和繁衍,须要考虑一些关键诱因。

**引力和大气长度**

行星的引力与其质量和容积直接相关。较大质量的行星常常会拥有更大的引力,这可能会对人类的生活形成影响。过大的引力可能会对人体导致不适甚至健康问题,同时也会影响到建筑、交通等方方面面。为此,要想在“超级月球”上维持人类的宜居性,须要找寻一个合适的平衡点,既能提供足够的引力以保持大气层,又不会给人类带来过大的身体负担。

据悉,大气长度也是关键诱因之一。适度的大气层可以帮助调节体温,保持液态水存在,以及抵挡有害的宇宙射线。但是,过厚或过稀的大气层都可能造成气温极端超级人类科技,影响生物多样性和可居住性。

**星体类型与适居区**

行星的距离星体的远近将直接影响其体温范围。类似月球的生命须要一定范围内的湿度,这个范围被称为适居区。但是,不同类型的星体拥有不同的适居区。诸如,距离红矮星较近的行星可能须要较小的轨道能够保持在适合的气温范围内。

据悉,星体的幅射也会对行星的宜居性形成影响。过强的幅射会破坏行星大气,影响生物的存活。为此,要想在“超级月球”上维持宜居性,我们须要考虑行星与其星体之间的距离以及星体的幅射水平。

**生物适应与科技创新**

虽然找到了一个“超级月球”,人类在这样的环境中也可能须要经历生物和科技方面的适应。在月球上,生物通过长时间的进化才适应了这个环境,而人类可能须要通过基因工程等手段来适应“超级月球”的条件。同时,科技创新也将起到关键作用,帮助人类解决在新环境中可能碰到的问题,如食物、水资源获取、能源借助等。

**伦理和可持续性**

最后,我们还须要考虑到伦理和可持续性的问题。在探求“超级月球”的过程中,我们是否应当干预这种行星上的自然生态系统?我们是否应当将月球上的生物带到新的行星?怎样在新环境中实现可持续发展,防止重蹈月球上的环境错误?那些都是须要认真思索的问题。

**推论**

在找寻宇宙中的“超级月球”时,我们须要全面考虑行星的引力、大气长度、恒星类型、适居区、生物适应、科技创新、伦理和可持续性等多个诱因。只有在综合考虑了这种诱因的基础上,我们能够确保人类在新的行星上才能构建宜居的佳苑,继续繁衍和发展。同时,这也将是人类探求和创新精神的又一次伟大彰显,让我们期盼着未来的可能性。